广西民族大学、梧州学院吴伟林团队在《计算机工程与设计》2025年第46卷第4期发表论文《基于多任务学习的全景驾驶感知算法》,该研究针对传统YOLOP全景驾驶感知算法存在的特征图池化自适应差、下采样细节丢失等问题,提出一种优化的多任务学习感知算法,显著提升车辆检测、可行驶区域分割与车道线检测性能,为智能驾驶环境感知提供高效技术方案。

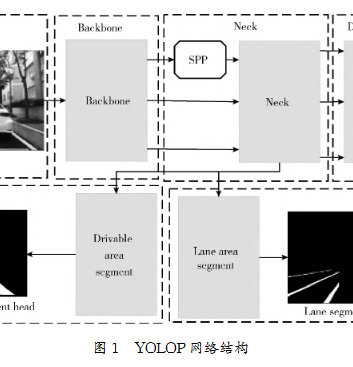

随着智能网联汽车与自动驾驶技术快速发展,全景驾驶感知成为核心技术环节。现有YOLOP多任务感知模型在实际应用中,存在特征处理适应性不足、图像细节丢失、检测精度有待提升等短板。为此,吴伟林联合刘春泉、余孝源等研究人员,基于多任务学习框架对YOLOP算法进行系统性改进。

研究团队在网络结构中引入C2f模块、SPPF模块与转置卷积,替换原有低效结构,提升特征提取效率与细节恢复能力;新增特征对齐网络,优化多尺度特征融合流程;调整损失函数权重,采用焦点损失与DiceLoss组合策略,强化车道线等关键目标检测效果。同时精简网络冗余层,在保持轻量化的前提下提升推理速度。

实验基于BDD100K与KITTI两大公开数据集验证,结果显示:新算法参数量仅11.0M,推理速度达18.0ms,与原始YOLOP相当;车道线检测准确率提升11.6%,可行驶区域检测mIoU提升2.1%,车辆检测mAP50提升3.7%。在KITTI数据集上,车辆检测mAP50提升3.4%,参数量减少2.1M,训练速度提升3.8倍。对比MultiNet、DLT‑Net、YOLOv5s等主流模型,新算法在多项指标上实现领先,且具备更强的鲁棒性与泛化能力。

该研究得到国家自然科学基金、广西科技基地人才专项等项目支持,所提出的算法结构简洁、性能优异,可直接部署于车载边缘计算平台,能有效提升自动驾驶系统在复杂路况下的感知精度与安全性。团队表示,后续将继续优化网络结构,推动算法在真实自动驾驶生态中落地应用。

转载请注明来自:http://www.lunwencheng.com/lwdt/22774.html