��������һ���ڸ��Ӷ��ķǽṹ�����������ɲ����ǻ������о����Ŀ��֮һ���������Թ�����ʽ����������������(SNN)�����������������Ҫ������ʽ���������õ���������ԣ��ڻ��������ܿ������������ܵ���ע�����ĶԻ���SNN�Ļ������������ܿ�������о�չ��������������Ϊ�����˺���������������о��������������ȣ�����SNN�ķ�չ���̡���Ԫģ�͡����뷽ʽ��ͻ�������Ժ�����ṹ�����֪ʶ����Σ����������˶��������ƻ��ƣ�����һ�ֻ���SNN�Ļ������������ܿ��ƿ�ܡ��ٴΣ����˶����ơ���˳���ơ�Эͬ��������������ܻ������������ܿ��Ʋ��Ե��о���չ����Ի���SNN�Ļ������������ܿ��Ƽ����������ܽ���չ����

�����ؼ��ʣ�����������;�˶�����;��˳����;Эͬ����

�������ġ���������������Ļ��������ܿ����о���չ�������ڡ���Ϣ�����������Ȩ�顶��Ϣ����ơ����С�������������ƽ̨�������ο���

��������

�������ܻ������ڹ�ҵ�������ճ������а�����������Ҫ�Ľ�ɫ���������������Ի����������˶����ƺ;�ϸ���������������Խ��Խ�ߵ�Ҫ��;��ҽ��������Ҫ��������������Э�������ṩ�������ܻ�����ϸ����ҽ�Ʒ���;�����Ѿ�Ԯ�ȼ��˻����У������˵�Ӧ������Ҳ������������ǰ�����˼��������ž������ܷ���չ��

�����������ܻ�����ּ�ڹ����߱�����������֪���ɿ����ܾ�������Ȼ�˶������滮�Ļ�����ϵͳ�����ŶԻ����������������ܻ���Ҫ����ߣ������˿����д��ڶ�����˳������³���Բ�������ս���ر����ڷǽṹ�������б���Э���˶����ơ�������˳��������Ч�˻�Эͬ�ȷ������кܴ�������ռ䡣��һ��������Ϊ���л�����ϵͳ�������ܴ��������ȡ�ϵͳ�ظ����ȡ��������������Լ��ܺĵ�������Լ����һ��������Ϊ�ǽṹ�������д����Ÿ��Ӷ�䡢��������ǿ��ȷ���Ե����ء������Щ����δ֪����ʱ����ͳ�Ļ����˿��Ƽ������������������׳�����

����������δ֪�ķǽṹ�������У��ܳ�ɫ�ؿ������������˳�������ر�������Ϊ���ƾ��Ƚϵ͡�������������£����Կ���������Ի�����ڸ����嵥Ԫ�����������������ܡ���Ի����˵Ŀ����о����ż��������������ԣ����������ѧ�߶��������ܻ�����չ���о�������ѧ�о����������Բ������巽ʽ������Ϣ�����봦������ˣ�����˴��Ե���Ϣ�������Ƶ�SNN�ܵ��˹㷺��ע���о�������SNN�������ڷǽṹ�������µ��������������Ӧ�ԣ�������ʹ�����˲������߷����Ժ���˳�ԡ�ͬʱ��SNN���߱�����DZ�������Խϵ��Ĵ��������˿����еĸ�ά���ݡ���ˣ�����SNN�Ļ������������ܿ�����һ��ֵ�������о��ķ���

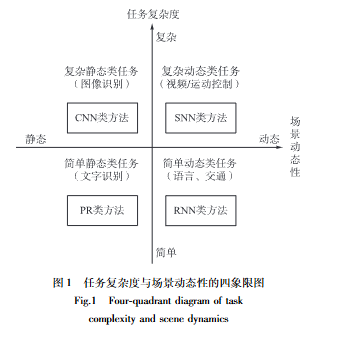

�������ݶ��ֳ����´�������ĸ����Լ���̬�ԣ��ɹ���������ͼ����Լ�̬�������������ʶ�𣬿�ͨ��ģ��ƥ���ģʽʶ��������;��Ը��Ӿ�̬��������ͼ��ʶ�𣬿�ͨ������������������;��Լ�̬�����������Ի�ͨ��Ԥ�⣬������ѭ��������(RNN)�༰Transformer�ȷ��������ܻ���Transformer����Ĵ�ģ�����������ɼ���Ƶ���ɵȸ��Ӷ�̬����������չ�ֳ���ǿ����������������Դ����Դ����Ը��Ӷ�̬����������Ƶ����˳�˶����ƣ�Ŀǰ��ȱ����Ч�Ľ������������SNN���������������ܹ�������û���ʱ���¼�����Ϣ����SNN������Transformer�ȼ�������Է������ߵ����ơ�������Ը��Ӷ�̬������Ԥ��SNN���нϴ�ķ�չ�ռ䡣��ˣ��Ի���SNN�Ļ������������ܿ���չ���о����Ż��������塣

����1 ������������������

����1997�꣬MAASS֤����SNN�ܹ�ʵ���������������ıƽ����ʳ�SNNΪ�������˹������硣���˹�������(ANN)��ȣ�SNN����������Ե�����ʽ������ʽ��������������ԡ�SNN�ķ�չ���̴��¿��Է�Ϊ3���Ρ����ڽ�����Ԫ��ģΪ����̽����������ѧ��������Ԫģ�ͼ���������ģ�ͣ�����H-H(Hodgkin-Huxley)ģ�͡�IF(integrate-and-fire)ģ�͡�Izhikevichģ�͵ȡ�1997�������SNN����ʽ�������������SNN���繹��Ϊ���������㷨�����Ρ�1997�꣬MARKRAM�����������ʱ������������(STDP)����2007�꣬IZHIKEVICH����˻��ڽ������Ƶ�����ʱ������������(R-STDP)����2015�꣬IBM�Ƴ�Truenorth����оƬ����־����������оƬʱ���ĵ������ڸý��������㷨������оƬ��ͷ��������ٽ���ͬ�꣬DIEHL�Ȼ���SNN�����ලѧϰʵ����MNIST���Լ���95%����ȷ�ʣ�2018��Ӣ�ض��Ƴ�LoihiоƬ��2019���廪��ѧ�Ƴ������оƬ��2023��IBM���Ƴ�������оƬNorthPole��2024���㽭��ѧ�Ƴ������3оƬ���ɼ���SNN�ķ�չ���汻��ҵ���о��������ӡ�

����1.1 ��Ԫģ��

������Ԫ��SNN�Ļ������㵥Ԫ����Ԫģ�͵�������Ҫ�����������棺ģ������ѧ���Եķḻ�̶Ⱥͼ��㸴�Ӷȡ���ˣ�������߸���������Ժ͵ͼ��㸴�Ӷȵ���Ԫģ����ʵ�ָ�����SNN�Ĺؼ���������������Ԫģ����H-Hģ�͡�IFģ�͡�Izhikevichģ�͵ȡ�

����������Ԫ���ⲿ�̼��»���ֳ����ӵ����巢����طŵ���Ϊ��ͨ�����Է�Ϊ20���������ԡ�H-Hģ�;��нϸߵ���������ԣ�����Ҫ�����ĸ������㡣���֮�£�IFģ�ͼ����࣬��ͨ�����������ź�ֱ���ﵽ��ֵ���������壬�Ӷ��ڱ���һ����������Ե�ͬʱ��������˼��㸴�Ӷȡ���ȻIFģ������ȷģ����Ԫ�������������ԣ���IFģ�ͼ��������ʵ�ִ��ģSNNʱ�ṩ��һ����Ч��ʵ�õ�ѡ��ͬģ�͵�ѡ����Ҫ�����ض�Ӧ�õ�����Ϳ�����Դ����Ȩ�⡣

����1.2 ���뷽ʽ

����SNNʹ����ɢ�������н�����Ϣ���ݣ�������źŶ�Ϊʱ���ģ���źš���ˣ���Ҫ��������Ԫ���ⲿ�źŽ��б��룬����ת��Ϊ����������Ϣ�������ı��뷽ʽ��Ƶ�ʱ��롢ʱ������Ⱥ����ȡ�

����Ƶ�ʱ�����һ�ִ�ͳ������Ϣ���뷽ʽ��ֻ��������ķ���Ƶ�ʣ��������������е�ʱ����Ϣ����ͨ��ʱ�䴰���ڵ��������и�������ӳ���Ĵ̼�ǿ�ȣ���ʵ�ּ����㷺Ӧ�á�

����ʱ��������������еľ�ȷʱ���ʾ�̼���Ϣ������Ϣ�����뵽���������е�ʱ��ṹ�С���Ƶ�ʱ�����ȣ�ʱ��������������������е�ʱ�����ԣ���������ϡ�裬����Ч�ʸ��ߡ�Ŀǰ��ʱ����뷽ʽ����������ʱ����롢������롢�����ӳٱ���ȡ�

����Ⱥ�������ö����Ԫ�ļ�Ⱥ�����������Ϣ�����Ը��õر������Ĵ̼���Ϣ�����⣬Ⱥ�����ʵ��ϡ����룬����ͨ����˹����Ұ��������Ԫ��������������źŵı�ʾ���ȡ�Ⱥ������SNN��ǿ��ѧϰ��ϵ�����㷨�б��㷺ʹ�á�

����һ����˵���ӱ���ʵ�ֵĸ��Ӷ��Ͽ������Ӷ��ɵ͵���������Ƶ�ʱ��롢ʱ����롢Ⱥ���롣�ӱ��뷽ʽ���ܷ�ӳ����Ϣ��������������Ϣ�����ɵ͵���Ҳ������Ƶ�ʱ��롢ʱ����롢Ⱥ���롣

����1.3 ͻ��������

����ͻ����������ָ��Ԫ֮��ͻ��������ǿ�ȿɸı�����ԣ�����Ϊ������ʵ��ѧϰ�ͼ������Ҫ����������1949�꣬HEBB��������������ͻ�������Խ����˼��裬����˺ղ���������STDP����ɱ���Ϊ�Ǻղ������һ����չ��STDP������Ҫ������ʱ����ǿ����(LTP)�ͳ�ʱ����������(LTD)����ͻ��ǰ��Ԫ��ͻ������Ԫ�ȷ�������ʱ����LTP����֮����LTD��ͻ������ǿ�Ȼ�ȡ��������Ԫ���������ʱ�����⣬�����������л������Ŷ�ʱͻ�������ԡ�ͻ������֯�����Ͳ����Ƶȿ�����ѧϰ����

����ͻ��������Ҳ�ܵ����ʵ�Ӱ�죬���Ͱ�������������������صȡ�IZHIKEVICH��2007�������һ�ֶ�Ͱ����ڵ�STDP����R-STDP���������������ǻ��ڴ��Ե�Զ�˽������裺���ض��ķŵ�˳������ͻ���仯ʱ������Ͱ��ڼ����ӵĹؼ�ʱ�䴰�����ڳ��֣������ֱ仯�ͻ���ǿ�������STDP��R-STDP��һ���̶��Ͻ�����ͻ���ı�����δٽ���ϵͳĿ��ʵ�ֵġ����⣬R-STDP�����˽����źţ�ʹ������Ը������ݼ��ʹ��ģ����ʱ���нϸ����ܡ���ˣ�R-STDP�ڻ����������б��㷺Ӧ�á�

����1.4 ��������

�����������Ͽ���SNN�����˽ṹ�ɷ�Ϊǰ���ͺ͵ݹ��������ࡣǰ����SNN����Ϣ�����ǵ���ģ�ÿ����Ԫ������������һ��ڵ���������Ԫ������õ��˽ڵ������������ݸ���һ��ڵ㡣��ǰ����SNN��ȣ��ݹ���SNN���и��ḻ�Ķ�̬���Ժ��ߵļ�����������Ҳ����ѵ���ͷ������ݹ���SNN�ֿ��Է�Ϊʱ��ݹ���SNN�ͽṹ�ݹ���SNN�������͡���ʱ��ݹ���SNN�У���Ԫ�������Խ���������Ԫ����Ϣ��Ҳ���Խ�����������Ϣ���γɻ�·�ṹ�����Ҳ����Ϊѭ����SNN��ʱ��ݹ���SNN���ж��ڼ����������Ҹ��ӷ�������������ṹ���ṹ�ݹ���SNN����������/ͼ�ṹ�����ֽṹ��Ҫ���Ѵ����˹�ȥ��ע����ˣ���Ŀǰʵ��Ӧ����SNN����ʹ�ýṹ�ݹ������˽ṹ��

��������ǰ����������е�����Ϣ�����ԣ�ǰ����SNN�����ڶ�ʵʱ��Ҫ��ϸߵij��������磬LELE�������һ�����ڻ�����֪��ǰ����SNN����ģ�Ϳ����ڵ�������ģʽ������(CPG)�ϲ��������̬��ÿ����̬��ת����������������̬ת���ٶȵ�������ʹ����������ܹ����õز��ԺͶ�ܲ�ʳ�ߡ�Ϊ�����SNN��Ӧ����������ԣ�AZIMIRAD�������һ�����˽ṹ�ɱ��ǰ����SNN��ͨ�����������ı仯���ı�����ṹ��ʹ��������Ӧ��̬�����ı仯�������ǰ����SNN���ݹ���SNN���������ڸ��ӷḻ�Ķ�̬�����������������˳����ڸ��Ӷ�̬�ij��������磬ARENA�ȸ���������Ե�Ģ����(MB)�ṹ�����һ�ַ�����ʱ��ݹ�SNN��ͨ�������������˶��������ؼ��������ݻ����̣����Ľ����е��˶���Ԫ��Ϊ��ѧϰ��̬�����ı仯���ɣ�RUECKERT�������һ��ʱ��ݹ���SNN������״̬��Ԫͨ��R-STDPͻ������ӣ�ͨ��R-STDP����̬�����仯���ԣ�����ģ��ѧϰ��ѹ滮���ԡ�

����2 ����SNN�Ļ������������ܿ��ƿ��

�������Կ���֫���˶���һ�����ӵıջ�ϵͳ�����У�ǰ��ҶƤ��ͨ�����������Ӿ��������������Ȳ�ͬ�о�ͨ������Ϣ����ϸ���ļ��䡢��кͶ������������������ľ��ߡ���ǰ��ҶƤ�������������ߺ���ͨ��ͻ���ͷ��˷������ʣ������˶�Ƥ����Ԫ���˶�Ƥ�㿪ʼ�滮�ͱ��Ÿ��ӵ��˶����У��ۺϿ��Ƕ�����˳�����ȼ��ٶȡ�����˶�Ƥ�����Ԫ�ͷŹȰ��ᣬ��������ڵ���·�����������ö�Ͱ���γ-��������(GABA)���˷ܺ������ź�֮����о�ϸ������ͬʱ��С������һ������ͨ���Ƚ�Ԥ���˶������ʵ�ʸо����������˶���ʱ��Ϳռ侫�Ƚ���ʵʱ������ȷ��������Э����ƽ����Ȼ������Ԫͨ������С�Ե��˶��źź��ⲿ�о������룬���ɷ����Ժ��Զ������˶��źţ����ͷ��˷������ʣ�ֱ�ӿ��Ƽ������������ɡ���о����彫���յ��Ĵ̼�ת��Ϊ������λ��ͨ����������ά�����о�Ƥ����д������ٷ�����ǰ��ҶƤ�㣬�γ�һ���ջ�ϵͳ��

�������Ľ��������˶��������ƻ��ƣ�����һ�ֻ���SNN�Ļ������������ܿ��ƿ�ܡ��ÿ�ܰ������Ծ���ģ�͡����Կ��Ʋ��ԡ������˱����֪ϵͳ�ĸ����֡����ȣ����Ծ���ģ�Ͳ���ͨ����������Ŀ��(r(t))�뵱ǰʱ�̹ؽڿռ�͵ѿ����ռ��״̬����((q(t), dot{q}(t)))��((x(t), dot{x}(t)))���Ի����˵���Ϊ���о��ߣ������ϲ��������((q_{d}, dot{q}_{d}))��Ȼ�����Կ��Ʋ��Բ��ָ��ݾ����Ӧ�ó������ϲ��������ת��Ϊ�ײ��������(( au_{c}, q_{c}, dot{q}_{c}))�����ţ������˱�����ݽ��յ��ĵײ�������ִ��ָ������������(a(t))�����֪ϵͳ��û����˱��嶯������Ļ���״̬�ı������������״̬��������Ϊ��һʱ�����Ծ���ģ�Ͳ��ֵ����룬�Ӷ���ʼ��һ�ֵĿ��ƻ�·��ͨ����·�IJ��ϸ�����������������ܹ�ʵ�ָ߶����;�ȷ������ִ�У��Ӷ����õ���Ӧ���Ӷ��Ļ�����

�����������������������ܿ����о��ɹ������˸ÿ�ܵ������ԡ����磬�ϵ����������һ��������ģ�ͣ����ڲ�ȷ���������µľ�ȷ��������������У��������ǰ��Ƥ��ģ�Ϳ�����Ϊ���Ծ���ģ�͡�С��ģ���������Կ��Ʋ��Բ����������˱��塣�����˱���������ڽ��յ������ִ�в�������˶�����������������ͷ��Ϊ��֪ϵͳ����������仯������״̬��Ϣ�����������Ծ���ģ�͡����⣬TIECK�Ȼ��ڴ��Ե��˶����ƻ��������һ������SNNģ�ͣ����ڻ�е���ڸ��ӻ����еĸ߾�����ץȡ�������У�������ģ�Ͱ��������Ծ���ģ�͵Ľ�ɫ��������·ģ��ѡ����ʵ�ץ�ղ��ԣ�������ת��Ϊ�����������������е�֣��������Կ��Ʋ������ɵ����á���е���ϵĵ���������ڽ��յ������ִ��ץȡ���������֪ϵͳͨ������������ʵʱ���Ӵ���������״̬��Ϣ��������������ģ�͡�

����3 �������������ܿ��Ʋ���

��������Ӧ�ó����ͻ���������ˮƽ�IJ�ͬ���ɽ������˿��Ʒ�Ϊ�˶����ơ���˳���ƺ�Эͬ�����������档�˶������ǻ����˿��ƵĻ�������Ŀ���DZ�֤������λ�˾�ȷ���ȶ����ٶ�ȷ��ƽ�����Ա���������Ԥ����������˳�������˶����ƵĽ��ף����˶����ƵĻ����������˶Ի����˵������ƣ�ʹ�����˸������������˳Ӧ�ԡ�Эͬ����������˳���ƵĻ������������˻�����������ʹ��������˸��õ�Э��������ض��������潫����SNN���˶����ơ���˳���ƺ�Эͬ��������������о���״��

����3.1 �˶�����

����SNN�Ի������˶�����Ч���ĸ�����Ҫ�������˶����ȡ�³���Ժ�ʵʱ���������档

����3.1.1 �˶����ȷ���

���������˵��˶�����һ���ö�λ���Ⱥ��ظ���������������λ�����ǻ������˶���������������˶����Ⱥ���ָ�ꡣSNN���л����˾��ȿ��Ƶ�һ�ּ����ǣ��ṩһ���ⲿѵ���źţ����ź���ͻ�������Ե�Ӱ���µ���ͻ��Ȩ�أ�ѵ��SNN���Ӷ����������˵��˶����ȡ�CARRILLO�Ȼ���STDP���һ������С��ģ�ͣ����ڿ��������ɶȻ�е�ۡ�ģ�ͽ��ؽڽǶȡ��ٶȼ�Ŀ��λ����Ϊ���룬ѵ��SNN������STDP��ѧϰ�������˶�����������ʵ��״̬֮��IJ��졣ʵ���������ģ������˻�е����Ŀ�굽�������еĶ�λ���ȡ�

����Ϊ�˽��STDP�ڴ�����������ʱ�������ֲܾ��Ż����Ƶ����⣬�������ܴ������ڼ�������R-STDPѧϰ���÷�������ȫ�ֽ����źţ����������������ִ�и��������е��˶����ƾ��ȡ�BING�Ȳ��û���R-STDP��ȫ����SNN�������С�����ơ�ͨ���¼����(DVS)����ȡ���켣�仯���¼�֡����Ϊ���롣���ÿ�������R-STDP�������ƶ���Ӧ�Ľ�������Щ������Ӱ��Ȩ�ر仯���Ӷ�����С����ת����Ϊ���ڴ��о������ϣ�BING�Ƚ�һ�������һ�ֻ���R-STDP��SNN����ģ�ͣ����������Qѧϰ(DQN)��Ϊѧϰ���ԣ�����·����������ϡ�ʵ��֤���˻���SNN�Ŀ������ܹ����ٵش����ݼ����ռ�֪ʶ����������Ч����

����SNNģ�Ϳ����뾭�䷽����ϣ�ȡ�����̣��Ӷ���������Ŀ���Ч����LELE��ʹ��SNN��CNN���ϡ��¼�����봫ͳ������ϵķ�ʽ����ʵ�顣���������SNN��CNN���ϵķ�ʽ������ȡ�ø��ߵľ��ȼ����͵��ӳ١���ΪSNN�ڸ����ƶ������˻�Ŀ�궨λ����ǡ���ֲ���CNN�����ȱ�㡣���⣬SNN�����ѧϰ��ϣ�����������ѧϰ�ܺĹ��ߵ����⡣DEWOLF�Ƚ��SNN�����ѧϰ����LoihiоƬ�ϴ�������ܹ������������ɶȻ�е�۵�ĩ�˿��ơ�ʵ������ʾ����������̬��������ִ��������������ʱ�����������켣��ƫ����ȷ�����������߳�4.13%������ʡ��������������������

����3.1.2 �˶�ʵʱ�Է���

����SNN���¼�������ϡ������Ϊ���ϵͳ���������ͽ����ӳ��ṩ����˼·���ر�����Ƕ��ʽϵͳ�ϣ���Щ�����������������ݻ�ȡ�봦����ʱ�䡣LELE������SNN���¼��������ԣ���˱ջ��˵��˵Ŀ���ϵͳ�����������˸��������е��ӳ١��ڴ˻����ϣ�LELE������SNN��ϡ�����Խ�������������ִ�н����˶�ʱ�����ĸ��ӳ����⣬�Ӷ�����Դ���Ļ����дﵽ70%�ijɹ��ʡ�ģ�´����е��ӳٲ�����������һ�ֽ�����ʱӰ���˼·��ABADIA������С�Ե�����ѧ���ƽ����ӳٲ�������Ч����˻�����Ť�ؿ����еļ���ʹ���ʱ���ӳ����⡣

����SNN��ǿ��ѧϰ���Ҳ����������˶�ʵʱ�Ե�һ��·����OIKONOMOU�ȿ�����һ�ֻ���SNN�����ȷ���Բ����ݶ�(DDPG)�㷨�Ļ��ǿ��ѧϰ���������������ɶȻ�е�۵ļ�ȡ����ʵ��������봫ͳ��DDPGģ����ȣ��û��ģ�����������ʱ��ͳɹ��ʷ�����ָ��á�����������DDPG���ģ�ͣ�OIKONOMOU���������һ���Ż���е��ʵʱ�˶����ƵĻ��ǿ��ѧϰ�㷨������SNN��Ϊ��Ա���磬�����ģ����Ѱ����Ѷ�����ʱ��ʵʱ�Ժ���ԴЧ�ʡ����⣬AMAYA�Ƚ�SNN������Ա���ۼ��㷨(SAC)��ϣ�����˻������ڲ�ȷ�������е��˶����ƾ��ȡ�

������SNNģ�Ͳ�������Ӳ��ƽ̨��Ҳ����������˶�ʵʱ�Ե��ֶΡ�DUPEYROUX�����ͷ������м���������̬Ӳ��оƬLoihi�������SNNʵ���˾���½������ʵ����ʵ���У����ֻ���SNN��ϵͳչʾ�����ڴ���������������ɢ�Է�������������⣬BATRES-MENDOZA�Ƚ���Ի��ӿڼ�����SNN��ͨ�������ߵ���������ƻ����ˣ�ʵ���˸ߴ�99.87%��ʶ���ʡ�

����3.1.3 �˶�³���Է���

���������˿���ϵͳ�Ŀ����źͿ���������������Ҫ������ϵͳ��³������ָ��ϵͳ���ٲ�ȷ���Ŷ�������£���Ȼ���Ա��ֽϺõ����ܡ�SNN�����ͻ�������ԡ��������ƵȻ��ƣ���Ӧ�Ը��ź�����ʱ�߱��Ϻõ�³���ԡ������ѧ����̽����SNN�Ļ������ԣ���ͻ�������ԺͲ������ƻ��ƣ�����ǿ������ϵͳ����Ի������ź�����ʱ���˶�³���ԡ�CARRILLO�ȵ��о�����һ�εĴ��������ǿ����˻���SNN��С��ģ�ͣ����ڿ��ƾ��������ɶȵĻ�е�ۡ������������SNN������Ӧ����������˻�е����ִ�о�ȷ�˶�����ʱ�����ܡ�

����SNN������ڻ���Ҳ�����³���Եķ���֮һ��ABUBAKER��ͨ�������Ͱ��������ƣ�����SNNģ�����ҵ������Ż������ڻ��Ƶ����룬������������˶���³���ԣ��������������ź�ϵͳ�����仯ʱ����Ч����Ϊͻ�������ѧ������ͻ�������ԺͲ������ƻ��ƵȻ����Ͻ�һ����չ��ZAIDEL����SNN�������˻������̿��(NEF)������̬�㷨��������Ӧ���������ɶȵĻ�е�ۡ��÷��������̳���SNN��ԭ�����ƣ������ڴ����������˶�����ʱ���ֳ�������Ч���������˺��о��߽�һ��̽��SNN�ڸ�����ս��Ӧ�ó����е�DZ����LUQUE������SNN����������С��ģ�ͣ����и��غ������������½��о�ȷ�켣�ٲ��ԣ�չ����SNN�������Ը��ӡ���ȷ���ߵĻ����е���Խ���ܡ�

�����ڻ������˶���������SNNչ�ֳ������������ƣ���ĿǰҲ������һЩ�����ԡ����˶����ȷ��棬SNNͨ���ⲿѵ���źź�ͻ�������Ե������������ȣ���STDPѧϰ�����ڿ��ٱ仯���Ԥ���Գ����б��ֲ��ѡ����˶�ʵʱ�Է��棬SNN���¼�������ϡ���������������ʹ����ӳ٣���������Ƕ��ʽϵͳ�С����⣬SNN���ǿ��ѧϰ�㷨�������ʵʱ�Ե�DZ������SNN��ѵ���������ȶ����Դ��ڲ��㡣���˶�³���Է��棬SNN��ͻ�������ԺͲ������ƻ��Ƶ�Ӧ�ã�ʹ����Ӧ�Ը��ź�����ʱ�߱��Ϻõ�³���ԡ���SNN�ڸ��Ӷ�价���е���Ӧ�Ժͳ����ȶ��Ի����һ���о���������˵��SNN�ڻ������˶������ϵ�Ӧ����ʾ��DZ�������ڻ�����ʵ��Ӧ���еı����д�������

����3.2 ��˳����

���������˻����н���ʱ������������������Ϊ����Դ�ͻ�����ȷ���Ըߵ���ս���������˶��������Դ������ิ�ӳ������˶�ѧ����ѧ֮��Ĺ�ϵ����ˣ���˳����Ӧ�˶����������Ƿ��ǽӴ�����켣�仯֮��Ĺ�ϵ���ɽ���˳���Ʋ��Է�Ϊ�˶�ѧ��˳���ƺ�����˳���ơ�����ֱ���ܽ�����SNN��������˳���Ʒ�ʽ�е��о���

����3.2.1 �˶�ѧ��˳����

�����ڽṹ�������У���һ���˶����Ʒ�������Ϊ�����˿����ṩ�Ϻõľ��ȡ���������Բ�����ȷ�����ⲿ����ʱ����ͳ�������Խ���ȷģ�ͣ��������Ա�֤�������̵��ȶ�������˳�ԡ�ͬʱ���ӳ�������ϵͳ��Ӧ�ٶ�Ҳֱ��Ӱ���ŷ���Ч����

����С��ģ������˳���Ƶ���Ч����֮һ������ѧ���Ʊ�����С�Ը���ϸ�˶�Э������Ӧ�Կ��ơ�ABADIA���ڷ������ƻ�·���ĵ�Ԫ�У�����С��ģ��ʵ����һ��SNN���������ÿ��ƻ�·ͨ��С��ģ��ʵ���˶Ի�е��6���ؽ�((J_{1}, J_{2}, cdots, J_{6}))��Ť�ؿ��ơ�����ͨ�����˶�ѧ�ķ������������˶��켣((x, y, z))ת��Ϊ��е�۹ؽ�λ�����ٶ�����((Q_{d}, dot{Q}_{d}))���������С��ģ�͡�ͬʱС��ģ�ͻ�ʵʱ���ջ�е�۸����ؽڵ�λ�á��ٶ�״̬((Q_{a}, dot{Q}_{a}))��Ϊ���롣����ѵ����С��ʵʱ���ÿ���ؽڵ�Ť������( au)������е��ִ��Ť���������ʵʱ״̬((Q_{a}, dot{Q}_{a}))������С��ģ�͡����⣬���ƻ�·ͨ���������ؽ�״̬��ʵ�ʹؽ�״̬�ĶԱȣ�����ָ�����ź�(varepsilon)�������С�ԣ���ʵ�ָ�������Ч����С��ģ�͵����˽ṹ�ǻ���SNN������ϸ����С�����磬����5����Ԫ�����˽ṹ����ͨ��ģ��С��ģ���е�̦��ά��(MF)�Ϳ���ϸ����(GC)�Ľ�������ϡ��ӳ���е���˶������е�ʱ�չ�ϵ������ϡ��ӳ���ʱ�չ�ϵ��Ϣͨ��ƽ����ά(PF)���䵽�ֿ�Ұϸ����(PC)�У�����STDP��������С��ѧϰϡ��ʱ�չ�ϵ�����������⣬������ά(CF)ͨ��ָ��������ʵ��С�Եĸ��������ܡ����վ���С�������(DCN)���������С�����ʵʱŤ�����ʵ������������С��ģ�͵�ʵʱ����ѧϰ�£���е����ʵ�����ȶ������Ĺ켣���ơ��ڴ˻����ϣ�ABADIA����������С��ģ�͵Ļ�����������ģ��������Ե��ӳٲ������ƣ�ʹ��SNN��ͻ��Ȩ�ر仯����ȡ��е��ĩ�˱仯������������켣��ʱ��ά���ϵı仯���������������仯���Բ�ȷ���ӳٽ��ж�Ӧ�������Ӷ�����˻�е����˳������ʵʱ�ԡ�

����������SNN��С��ģ���뼡���ƶ�����ϣ��Ƕ�����С��ģ���о��Ľ�һ����չ����֫��ṹ��ƵĽǶȽ�һ��ģ������������ƣ��ر���ʹ�ü����������������ͳ�����˵ĸ������ˡ���һ��ϲ���������������ʵ�ֶԴ����������ģ�£��������쵽��Ӳ���Ĺ��죬ʹ�û������������ṹ�ϸ����������ﹹ�죬�Ӷ�ʵ�ָ��ӷ�������Ȼ���˶���ZHANG��ʵ����һ������С�����˽ṹ��SNN���������ÿ�����ͨ��̦��ά������ϸ����5��ϸ��ģ��С�Թ��ܣ���ѧϰ�����¶�������ģ�Ͳ��ֲ���������������Ӷ�������������������ϵͳ����Ӧ�ٶȡ��ڴ��о��Ļ����ϣ��������������һ����С��SNNģ�ͣ�����ȷ������ģ�ͣ��Ϳ���˳��������McKibben��������ԡ���ģ��ͨ��ѧϰ�����������Э��������ʵ����һ���̶��ϵ�����Ӧ��˳���ơ�

�������������Ͽ���Ҳ��SNN����˳����������Ӧ�õ������ơ����ַ���������������������ж���������Э�����ơ��ϵ����Ƚ������塢С�ԡ�ǰ��ҶƤ��ȶ����������������ͨ��SNN����ʵ����“����-�滮-����”�����幦�ܡ����ַ�������ģ�����Ӿ�Ƥ��ĸо����ܺ�С�Եķ�Ӧ���ܣ���������ǰ��ҶƤ���Ԥ��滮���ܡ���ģ���ܹ�����С�IJ����ռ��н��л����Ӿ������ľ�ϸ��˳������չʾ��SNN�ڸ��ӻ�����������ϸ��˳���Ƶľ�DZ�������⣬����������ϵͳ�Ķ��������Ͽ���Ҳ��һ�ֿ��еĽ�������������ǵ������һ�ֻ���������ϵͳ�ķ����˶�����ģ�ͣ����ڿ��������ɶȻ�е�ۡ��÷�������ģ�Ͱ���4��ģ�飺��С�Ե�SNN�������˶�Ƥ��ģ�顢���Ըо�Ƥ��ģ��ͼ���ģ�顣������С�Ե�SNN�Ǻ��ģ�������STDP���Ƶ���ͻ��Ȩ�أ��ڲ�ͬ���غ켣��������Ч����˻�е�۵Ĺ켣����������

����3.2.2 ����˳����

�����������뻷���ĽӴ�����һֱ�ǻ����������е�һ���������⡣�Ӵ�������Ҫ��ϸ���������ڣ��Ա�֤�����ٲ�ȷ����ʱͨ���Ӵ���λִ���������ڵ��������о������������ȿ��ơ�BUTTERFASS��ͨ������ϵͳ�Զ�ؽ��ֽ���λ�ÿ��ơ��������о��У�ͨ���ڿ���ϵͳ��������������ʵ�ֶԹؽڲ����ľ�ϸ������Ȼ�������ֿ��Ʒ�ʽ����ʵ������ץ�չ����е�����������Ӧ�ԡ�

����SNN���Գ䵱����������������ϴ�ͳ������˳���Ƽܹ���ʵ�ָ��õĿ���Ч����ͨ��ѵ����SNN����ʹ��ͬ������˳������Ӧ��ͬ�Ķ����������������ѧϰ�ķ���ץȡģ����ȣ����������ڿ���ʹ�ø���������ѵ��������ɶ�����������ԣ�SNNͨ��ģ��������Թ��ܵķ�ʽ���ܹ�����ѧϰ����Ӧ�����仯���ڽ�ϴ�ͳ������˳���Ƽܹ�ʱ��SNN�����ṩʵʱ�ķ���������ʹ�������ڸ����Ҷ�̬�Ļ������ܹ����ָ�Ч�;��IJ�����TIECK�Ȼ���SNNʵ����һ�־�������ѧϰ���ܵ���˳���������ÿ���������Ҫ�������˶�ѧ���ӵĽӴ���滮��ֻ�����ץȡ������һ��ʾ����ѵ����Ԫ����ץȡ�����У���˳������ʹ�����ȷ�����Ϊ���Ʋ�����������ȷ������ָʩ�ӵ����������ƻ�����˳���������ͷ����źţ���˳����������ṩ�����ļ����ź�����ִ�л������Ӷ�ʵ����˳ץȡ������

��������SNN�����������ģ�ͣ��������������˳���Ƶ�����ӦЧ�����ھ�����������ʵ���У��������ȷ���ԡ��������ڽ��п��ٲ���ʱ�����������Ӵ����������Ҫ��ϸ�������ڡ�Ϊ��������⣬�ϵ��������һ�ֶ��������ϵ�SNNģ�ͣ��ڿ��ǽӴ�Ԥ��Ϳ��پ�����ͬʱʵ���˸�Ч���˶��滮����ģ��ͨ��ģ�⺣���塢С�Ժ�ǰ��Ƥ��Ĺ��ܹ�����һ�����ӵĶ����������硣������˵�����������縺����书�ܣ�Ԥ��Ӵ����ķֲ���ѧϰ��ʱ�����ԡ�ǰ��Ƥ�����縺��滮���ܣ���Ϲ�ȥ���ֺ͵�ǰ�����ƶ����ž������С�Խ��վ��������ѡ�����ſ��Ʋ��ԣ���̬���������˵�������Ӧ��

�����ڻ�������˳��������SNNչ���˶��ص����ơ����˶�ѧ��˳���Ʒ��棬SNNͨ��ģ��С������ṹ����Ч�������ʵʱ��˳���Ƶľ��ȡ�Ȼ������ǰSNN�㷨����Կ��ٱ仯�ij���ʱ��Ч�����д�����������SNN�Ķ��������Ͽ���ģ���ھ��������б��ֽ�Ϊ��ɫ�����临�ӵĽṹ���ļ���ɱ���������������ʵ�����µ�Ӧ�á�������˳���Ʒ��棬SNN���Խ�ϴ�ͳ����˳���Ƽܹ���ͨ����������ѧϰ�������������ڲ�ȷ��Ŀ�����Ե�����½�������Ӧץȡ����SNN�ڴ����߶ȶ�̬���ӻ����е�����ʱ�ľ��Ȼ��д���ߡ�������ԣ�SNN�ڻ�������˳����������ֳ����õķ�������Э����DZ���������ȶ��Ժͷ��������ڸ��ӻ����е�Ӧ�������һ���о�����֤��

����3.3 �˻�Эͬ����

�������˻�Эͬ�����У��˵Ķ��������Ժ�ǿ������������˶��˻�����ģ�͵Ľ����dz����ѣ���������������ͼ��ʶ�������Ԥ�ⷽ�档���������о��У���ͼת��ģ����Ҫ��ͨ���������ѧ�Ƶ������ģ�����ɽ����Խϲ���⣬���Ӿ���Ϣ�ر���ʱ���źŽ��д���ʱ��ʱ�䴰������ѡ����ʵʱ�Խϲ�����������ͼģ���Ժ�����Խ�ǿ��ͬ��ʱ���������ֳ��Ϻõ�����ԡ�Э���Ժ�ƽ���ԡ���Ϊ������ͼԤ��ģ�͵��о��ṩ�˲ο���SNN������ɽ����ԺͶ�ģ̬��Ϣ�������������Ȼ���ơ����⣬������Ԫ���ص�ͨ�ŷ�ʽ���ḻ�Ķ���ѧ����������SNN���ļ����ʱ����Ϣ������DZ�����������˻�Эͬ�ĽǶȽ���SNN��Эͬ�������������о���

���������˺��˵���Ϊ֮����������DZ�ڵ���Ϲ�ϵ����������ͼ������Ԥ������������˹滮�켣������ռ�����ཫҪʹ�õĹ����ռ䡣������ͼ������Ԥ�������ڶ�ģ̬�����ཻ�������������о���Ҫ������ʹ��ANN������������˶��켣Ԥ�⡣������ANN�����У�������Ԫ֮����ӳ��Dz���ģ���������Զ�ģ̬��Ϣ�첽ЧӦ��ģ�⡣���֮�£�SNN��������Ԫ��Ĵ����ӳ��ǿɱ�ģ�������Ը��õ�ģ���ģ̬��Ϣ���첽ЧӦ�����ң���ǰ����ANN���˻�Эͬ���Ƶ��о���Ҫ��ע�������˶��켣��Ԥ�⣬�������˻���ת��(turn-taking)ʱ�����ͼ��Ԥ�⡣

����SNN����ͨ����ϻ���ת��ģ�ͣ�����ڸ����˻����������е�������ͼԤ��Ч��������������һ�ֻ���SNN����֪����ת��ģ��(CTTM)������ʵ�����ҽ��������ת����ͼԤ�⡣�����������CTTMģ�����ܴ�����ڵ�ʱ���Ƚ���ת��Ԥ���㷨����ģ����ѧϰ����40%������ʱ���ﵽ���������Ч��������˻�Э����װ���������ٵ������һ�ֻ����ں�����������(FSNNs)��Эͬ����Ԥ�ⷽ�����÷���Ԥ�����ӽ�����Э����Ϊ����Ա�ṩ���ѺõĽ������顣��˼��������һ������Ԥ��ģ�ͣ�����װ�������������ת����Ԥ�⡣��ϵͳ����ʹ��Kinect���������Ա�Ĺ������ݣ���Щ���ݾ����������˺��ź���ǿ�����뵽SNNģ���С�SNNͨ��STDP����ѧϰ����Ա�Ķ���ϸ�ڣ���ǰԤ���˻�֮���ת����ͼ���Ӷ�������Ӧ�Ĺ켣�滮�Ϳ������ʵ�ָ�Ч�Ļ�����Эͬ������ʵ������������ģ����Э�������о��нϸߵĿɿ��Ժ�ƽ���ԡ�

����SNNͨ������ص�������Ԫģ�ͺ�ʱ����뷽ʽ���ܹ�ģ���������Ԫ�Ķ���ѧ���ԣ��dz��ʺϱ�ʾ�ʹ����������ʱ���źš���ˣ���Ի�������ʶ��������ǿ�������һ�����ɿ�ܣ�����ϡ����롢��Чѧϰ��³����������������Ԫ���ֲ�����-ʱ��(spectral-temporal)�����������������һ�ּ�ͨ�õı��뷽�����ñ��뷽����ȡ�Ĺؼ������������Ϣ��ʱ����Ϣ������ϡ����³���ر�ʾ�����źš���������е�SNNģ��ʹ�ö�����ѧϰ�������ѵ�������ڲ�ͬ�ֱ�������ˮƽ�½����������������㷨ƽ��ȷ�ʴﵽ98.68%���������㷨��ȣ����㷨���нϺõ�³���ԡ�����SNN��������������ʱ��ֻ��0.094ms�������ANN��CNN���㷨�����㷨���нϸߵļ���Ч�ʡ����⣬�⼽��Ȼ���SNN������һ�����������⡢��Դ��λ����������ʶ��3������ģ���ϵͳ���������㷨��ȣ���ϵͳ���нϺõ�ʵʱ�ԡ�³�����Լ��ϵ͵��ܺġ�

����Ŀǰ������SNN��Эͬ���Ƽ����о������ڳ����Σ�SNN��ҪӦ����Эͬ���Ƶĸ�֪��������ͼԤ����档���磬SNN�ܹ���Ч���������˶��켣��Ԥ�⣬����Э��������ʵ�ָ�Ч������Ԥ�⡣��ȻSNN�ڼ�Э���������ܹ���Խ�����Ԥ�������������ڴ������Ӹ��Ӻͷǽṹ���Ľ�������ʱ����������ƿ����

����4 �ܽ���չ��

��������������SNN���˶���������չʾ����߾��ȡ������ӳ١������ȶ��ԵĹ㷺ǰ��������˳��������SNNӦ�÷�Ϊ�˶�ѧ��˳���ƺ�����˳���ƣ����ֳ�ʵʱ�������ӳٲ�������������ѧϰ���ص㡣��Эͬ��������SNN�о��༯����������ͼԤ�⣬�ڴ��������˶��켣Ԥ�ⷽ����ֳ�DZ��������SNN�Ļ������������ܿ��Ƽ���ȡ����һЩ�о��ɹ������Ǹü����������ֵ�ý�һ��̽�����о��������а�����

����1) ����������SNN���Ƚ��ļ��������������ڸ�֪��ִ�л��ڡ��ڻ������������ܿ��ƿ�ܵ�4�������У�SNN�ڸ�֪��ִ�л�����Ӧ�ý��١�������Ϊ���������˵ĸ�֪��ִ��������ͨ�ô������ɼ�����������������������������SNN���ڳ̶Ȳ����ߡ������������״��¼�������̵���ΪSNN�ڸ�֪��ִ�л����ϵ�Ӧ���ṩ�˽ϴ����������磬�ڸ�֪���ڣ��¼���������¼��������Ĺ�����ʽ��SNN��ʱ����뷽ʽ���ܽ�ϣ���ַ�����SNN���ĵ��ŵ㡣��ִ�л��ڣ��������ϵͳ�ܹ�ģ�����༡������Ľṹ���˶���ʽ��ΪSNNʵ�ָ�ˮƽ������ѧ�����Ե������˶��ṩ��ִ�в���Ļ�������˿����Ƚ������������������һ������SNN��ʵ��Ӧ���е�DZ����

����2) ̽�����������˶�Э����ϵ��������˳���Ʒ�������ǰSNNѧϰ�㷨���ǵ����ӻ������˶�ѧ����ѧ�ĽǶȿ�����˳�ԣ������ټ����ڿ��ƹ����������˶���Э����ϵ�ϡ�����û�����ʵ�ֺ�����һ��������Э������˳��������ҪSNN�ܸ��õ�Э���Ӵ������˶�֮��Ķ�̬��ϵ��SNN����ѧϰ����Ӧ�����еı仯�����õز��Ӵ�����������˶�֮��Ķ�̬��ϵ�������ٽ�ʵ������������˳���Ƶ�Ŀ�ꡣ��ˣ�����Э�����ƽӴ������˶�����������̬��ϵ��SNNѧϰ�㷨��һ��ֵ��̽���ķ���

����3) �������ƹ�������SNN��Ӳ��ƽ̨��ͨ�ñ�̿�ܡ�GPU+CUDA+Pytorch����ͨ�ò��м���ƽ̨�ͱ��ģ�Ͳ�������SNN�����±��Ч�ʵͣ�Ӱ��SNN�Ĺ㷺Ӧ�á���˿����߱�ͨ���Ե�SNNѧϰ��ܼ�ͨ��SNN����оƬ��һ��ֵ���о����������߽������ѧϰ�����GPU�ķ�չһ���ศ��ɣ�����SNN�Ĺ㷺��չ��Ӧ�á�

�������������ǻ����˷�չ����Ҫ����֮һ����ǰ�������ܵ�������Դ�빦�ĵ���Լ��SNN���¼��������Ժ����������ƣ�ʹ�û�������Ӧ�Ը��ӺͶ�̬����ʱ���ֳ���ǿ��ʵʱ��������ı��֡���ˣ�����SNN�Ļ������������ܿ��Ƽ����������ھ�������Ը����ʵ�֡�

���������

����[1] SEMERARO F, GRIFFITHS A, CANGELOSI A. Human-robot collaboration and machine learning: A systematic review of recent research[J/OL]. Robotics and Computer-Integrated Manufacturing, 2023, 79[2024-04-01]. https://linkinghub.elsevier.com/retrieve/pii/S0736584522001156. DOI:10.1016/j.rcim.2022.102432.

����[2] ��ҫ��, ��һ��, ����, ��. �����˸�֪����ƹؼ�����������������Ӧ��[J]. �Զ���ѧ��, 2023, 49(3):494-513.

����[3] SIVAPARTHIPAN C B, MUTHU B, MANOGARAN R, et al. Innovative and efficient method of robotics for helping the Parkinson′s disease patient using IoT in big data analytics[J/OL]. Transactions on Emerging Telecommunications Technologies, 2020, 21(12)[2024-03-12]. https://onlinelibrary.wiley.com/doi/10.1002/ett.3838. DOI:10.1002/ett.3838.

����[4] WANG Y, TIAN P, ZHOU Y, et al. The encountered problems and solutions in the development of coal mine rescuer robot[J/OL]. Journal of robotics, 2018, 2018[2024-03-16]. https://onlinelibrary.wiley.com/doi/epdf/10.1155/2018/8471503. DOI:10.1155/2018/8471503.

����[5] ����ƽ, ����, �︻��, ��. ������̬�ľ��������о�: ��ʷ�ع���ǰ�ؽ�չ[J]. �Զ���ѧ��, 2023, 49(6):1131-1154.

����[6] ���㲷, ���IJ�, �쿭, ��. ���ھ������ܵ��ƶ�����������ϵͳ��չ�о�[J]. �й����̿�ѧ, 2024, 26(1):139-148.

����[7] LIU R R, NAGEOTTE F, ZANNE P, et al. Deep reinforcement learning for the control of robotic manipulation: A focussed mini-review[J/OL]. Robotics, 2021, 10(1)[2024-03-19]. https://www.mdpi.com/2218-6581/10/1/22. DOI:10.3390/robotics10010022.

����[8] NAKAMURA Y, NAGAI K, YOSHIKAWA T. Dynamics and stability in coordination of multiple robotic mechanisms[J]. The International Journal of Robotics Research, 1989, 8(2):44-61.

����[9] TRIVEDI D, RAHNC D, KIER W M, et al. Soft robotics: Biological inspiration, state of the art, and future research[J]. Applied Bionics and Biomechanics, 2008, 5(3):99-117.

����[10] GROOM V, NASS C. Can robots be teammates?: Benchmarks in human-robot teams[J]. Interaction studies, 2007, 8(3):483-500.

����[11] VALERO F, MATA V, BESA A. Trajectory planning in workspaces with obstacles taking into account the dynamic robot behaviour[J]. Mechanism and machine theory, 2006, 41(5):525-536.

����[12] �콨��, �ۿ���, ���ѻ�, ��. ���ڸĽ�ǿ��ѧϰ���ƶ������˶�̬���Ϸ���[J]. �й����Լ���ѧ��, 2023, 31(1):92-99.

����[13] VYSOCKY A, NOVAK P. Human-robot collaboration in industry[J]. MMScience Journal, 2016, 9(2):903-906.

����[14] HUA J, ZENG L C, LI G F, et al. Learning for a robot: Deep reinforcement learning, imitation learning, transfer learning[J/OL]. Sensors, 2021, 21(4)[2024-02-19]. https://www.mdpi.com/1424-8220/21/4/1278. DOI:10.3390/s21041278.

����[15] LIEDER F, GRIFFITHS T L. Resource-rational analysis: Understanding human cognition as the optimal use of limited computational resources[J/OL]. Behavioral and brain sciences, 2020, 43[2024-03-01]. https://www.cambridge.org/core/journals/behavioral-and-brain-sciences/article/abs/resource-rational-analysis-understanding-human-cognition-as-the-optimal-use-of-limited-computational-resources/586866D9AD1D1EA7A1EECE217D392F4A. DOI:10.1017/S0140525X1900061X.

����[16] QIAO H, CHEN J H, HUANG X. A survey of brain-inspired intelligent robots: Integration of vision, decision, motion control, and musculoskeletal systems[J]. IEEE Transactions on Cybernetics, 2022, 52(10):11267-11280.

����[17] BING Z S, MESCHEDE C, ROHRBEIN F, et al. A survey of robotics control based on learning-inspired spiking neural networks[J/OL]. Frontiers in neurorobotics, 2018, 12[2024-03-15]. https://www.frontiersin.org/articles/10.3389/fnbot.2018.00035/full. DOI:10.3389/fnbot.2018.00035.

����[18] XING D, YANG Y, ZHANG T, et al. A brain-inspired approach for probabilistic estimation and efficient planning in precision physical interaction[J]. IEEE Transactions on Cybernetics, 2022, 53(10):6248-6262.

����[19] ����ǿ, ������, ������. �������Լ���������������о�[J]. �й�ͼ��ͼ��ѧ��, 2023, 28(2):401-417.

����[20] MAASS W. Networks of spiking neurons: The third generation of neural network models[J]. Neural Networks, 1997, 10(9):1659-1671.

����[21] ������, �첨. �����������о���״��չ��[J]. �����ѧ��, 2021, 44(9):1767-1785.

����[22] ABADIA I, NAVEROS F, GARRIDO J A, et al. On robot compliance: A cerebellar control approach[J]. IEEE Transactions on Cybernetics, 2019, 51(5):2476-2489.

����[23] TIECK J C V, SECKER K, KAISER J, et al. Soft-grasping with an anthropomorphic robotic hand using spiking neurons[J]. IEEE Robotics and Automation Letters, 2020, 6(2):2894-2901.

����[24] MAOR X, LI S X, ZHANG Z M, et al. An ultra-energy-efficient and high accuracy ECG classification processor with SNN inference assisted by on-chip ANN learning[J]. IEEE Transactions on Biomedical Circuits and Systems, 2022, 16(5):832-841.

����[25] CONNELL S D, JAIN A K. Template-based online character recognition[J]. Pattern Recognition, 2001, 34(1):1-14.

����[26] LECUN Y, BOTTou L, BENGIO Y, et al. Gradient-based learning applied to document recognition[J]. Proceedings of the IEEE, 1998, 86(11):2278-2324.

����[27] LU S Q, ZHANG Q Y, CHENG S, et al. A combined method for short-term traffic flow prediction based on recurrent neural network[J]. Alexandria Engineering Journal, 2021, 60(1):87-94.

����[28] VASWANI A, ASHISH N, NIKI P, et al. Attention is all you need[C]//31st International Conference on Neural Information Processing. New York, USA: Curran Associates Inc., 2017:5998-6008.

����[29] Strubell E, Ganesh A, McCallum A. Energy and policy considerations for deep learning in NLP[C]//57th Annual Meeting of the Association for Computational Linguistics. Florence, Italy: Association for Computational Linguistics, 2019:3645-3650.

����[30] JIANG J G, HUANG Z Y, BI Z M, et al. State-of-the-Art control strategies for robotic PiH assembly[J/OL]. Robotics and Computer-Integrated Manufacturing, 2020, 65[2024-03-11]. https://www.sciencedirect.com/science/article/pii/S0736584519302418. DOI:10.1016/j.rcim.2019.101894.

����[31] ROY K, JAISWAL A, PANDA P. Towards spike-based machine intelligence with neuromorphic computing[J]. Nature, 2019, 575:607-617.

����[32] ZHOU Z K, ZHU Y S, HE C, et al. Spikformer: When Spiking neural network meets transformer[C/OL]. The Eleventh International Conference on Learning Representations.[2024-03-28]. https://openreview.net/forum?id=frE4fUwz_h.

����[33] ��һ��, �����, ������, ��. �����������о���չ����[J]. ���������, 2021, 36(1):1-26.

����[34] LAPIQUE L. Recherches quantitatives sur l′excitation electrique des nerfs traitee comme une polarization[J]. Journal of Physiology and Pathology, 1907, 9:620-635.

����[35] HEBB D O. The first stage of perception: Growth of the assembly[J]. The Organization of Behavior, 1949, 4(60):78-60.

����[36] HODGKIN A L, HUXLEY A F. Currents carried by sodium and potassium ions through the membrane of the giant axon of Loligo[J]. The Journal of physiology, 1952, 116(4):449-472.

����[37] RALL W. Theory of physiological properties of Dendrites[J]. Annals of the New York Academy of Sciences, 1962, 96:1071-1092.

����[38] MEAD C. Neuromorphic electronic systems[J]. Proceedings of the IEEE, 1990, 78(10):1629-1636.

����[39] MARKRAM H, LUBKE J, FROTSCHER M, et al. Regulation of synaptic efficacy by coincidence of postsynaptic APs and EPSP[J]. Science, 1997, 275(5297):213-215.

����[40] BOHTE S M, KOK J N, LAP H. Error-backpropagation in temporally encoded networks of spiking neurons[J]. Neurocomputing, 2002, 48(1):17-37.

����[41] IZHIKEVICH E M. Simple model of spiking neurons[J]. IEEE Transactions on Neural Networks, 2003, 14(6):1569-1572.

����[42] JOLIVET R, TIMOTHY J, GERSTNER W. The spike response model: A framework to predict neuronal spike trains[C]//2003 Joint International Conference on Artificial Neural Networks and Neural Information Processing. Berlin, Germany: Springer, 2003:846-853.

����[43] IZHIKEVICH E M. Solving the distal reward problem through linkage of STDP and dopamine signaling[J]. Cerebral Cortex, 2007, 17(10):2443-2452.

����[44] BICHLER O, QUERLIOZ D, THORPES J, et al. Unsupervised feature extraction from an asynchronous silicon retina through spike-timing-dependent plasticity[C]//2011 International Joint Conference on Neural Networks. Piscataway, USA: IEEE, 2011:859-866.

����[45] AKOPYAN F, SAWADA J, CASSIDY A, et al. True north: Design and toolflow of a 65mw 1 million neuron programmable neurosynaptic chip[J]. IEEE Transactions on Computer-aided Design of Integrated Circuits and Systems, 2015, 34(10):1537-1557.

����[46] DAVIES M, SRINIVASAN G, LIN T H, et al. Loihi: A neuromorphic manycore processor with on-chip learning[J]. IEEE Micro, 2018, 38(1):82-99.

����[47] PEI J, DENG L, SONG S, et al. Towards artificial general intelligence with hybrid Tianjic chip architecture[J]. Nature, 2019, 572(7767):106-111.

����[48] LEE C, SARWAR S S, PANDA P, et al. Enabling spike-based backpropagation for training deep neural network architectures[J/OL]. Frontiers in Neuroscience, 2020[2024-03-11]. https://www.frontiersin.org/journals/neuroscience/articles/10.3389/fnins.2020.00119/full. DOI:10.3389/fnins.2020.00119.

����[49] MODHA D S, AKOPYAN F, ANDREOPOULOS A, et al. Neural inference at the frontier of energy, space, and time[J]. Science, 2023, 382(6668):329-335.

����[50] MA D, JIN X F, SUN S C, et al. Darwin3: A large-scale neuromorphic chip with a novel isa and on-chip learning[J/OL]. National Science Review, 2024, 11(5)[2024-03-19]. https://academic.oup.com/nsr/search-results?page=1&q=Darwin3%3A%20A%20large-scale%20neuromorphic%20chip%20with%20a%20Novel%20ISA%20and%20On-Chip%20Learning&fl_SiteID=5332&SearchSourceType=1&allJournals=1. DOI:10.1093/nsr/nwae102.

����[51] DIEHL P U, COOK M. Unsupervised learning of digit recognition using spike-timing-dependent plasticity[J/OL]. Frontiers in Computational Neuroscience, 2015, 9[2024-03-12]. https://www.frontiersin.org/articles/10.3389/fncom.2015.00099/full. DOI:10.3389/fncom.2015.00099.

����[52] HODGKIN A L, HUXLEY A F. A quantitative description of membrane current and its application to conduction and excitation in nerve[J]. The Journal of Physiology, 1952, 117(4):500-544.

����[53] IZHIKEVICH E M. Which model to use for cortical spiking neurons?[J]. IEEE Transactions on Neural Networks, 2004, 15(5):1063-1070.

����[54] STEIN R B. A theoretical analysis of neuronal variability[J]. Biophysical Journal, 1965, 5(2):173-194.

����[55] �����, ������. ����������ԭ����Ӧ��[M]. ����: ��ѧ������, 2018:50-54.

����[56] KOBAYASHI T, KURIYAMA R, YAMAZAKI T. Testing an explicit method for multi-compartment neuron model simulation on a GPU[J]. Cognitive Computation, 2021, 15:1118-1131.

����[57] THEUNISSEN F, MILLER J P. Temporal encoding in nervous systems: A rigorous definition[J]. Journal of Computational Neuroscience, 1995, 2:149-162.

����[58] YAMAZAKI K, VO-HOVK B, BULSARA D, et al. Spiking neural networks and their applications: A Review[J/OL]. Brain Sciences, 2022, 12(7)[2024-03-02]. https://www.mdpi.com/2076-3425/12/7/863. DOI:10.3390/brainsci12070863.

����[59] VAN RULLEN R, GUYONNEAU R, THORPES J. Spike times make sense[J]. Trends in Neurosciences, 2005, 28(1):14.

����[60] THORPES J, GAUTRAIS J. Rank order coding[M]. Computational neuroscience. Berlin, Germany: Springer, 1998:113-118.

����[61] CHEN H T, NG K T, BERMAK A, et al. Spike latency coding in biologically inspired microelectronic nose[J]. IEEE Transactions on Biomedical Circuits and Systems, 2011, 5(2):160-168.

����[62] YAMANI J A, BOUSSAID F, BERMAK A, et al. Glomerular latency coding in artificial olfaction[J/OL]. Front Neuroengineering, 2012, 4[2024-03-06]. https://www.frontiersin.org/articles/10.3389/fneng.2011.00018/full. DOI:10.3389/fneng.2011.00018.

����[63] LEE C, ROHRER W H, SPARKS D L. Population coding of saccadic eye movements by neurons in the superior colliculus[J]. Nature, 1988, 332(6162):357-360.

����[64] GEORGOPOULOS A P, SCHWARTZ A B, KETTNER R E. Neuronal population coding of movement direction[J]. Science, 1986, 233(4771):1416-1419.

����[65] GUPTA S, SINGAL G, GARG D, et al. QC_SANE: Robust control in DRL using quantile critic with spiking actor and Normalized ensemble[J]. IEEE Transactions on Neural Networks and Learning Systems, 2023, 34(9):6656-6662.

����[66] ZHANG D Z, ZHANG T L, JIA S C, et al. Multi-scaled dynamic coding improved spiking actor network for reinforcement learning[J]. Proceedings of the AAAI Conference on Artificial Intelligence, 2022, 36(1):59-67.

����[67] HEBB D O. The organization of behavior: A neuropsychological theory[M]. London, UK: Psychology Press, 2005:28-30.

����[68] ROMAN I S, TSODYKS M. Short-term plasticity based network model of place cells dynamics[J]. Hippocampus, 2015, 25(1):94-105.

����[69] ZUCKER R S, REGEHR W G. Short-term synaptic plasticity[J]. Annual Review of Physiology, 2002, 64(1):355-405.

����[70] WHITTINGTON J C R, BOGACZ R. Theories of error back-propagation in the brain[J]. Trends in Cognitive Sciences, 2019, 23(3):235-250.

����[71] BLAKEMORE C, TOBINE A. Lateral inhibition between orientation detectors in the cat′s visual cortex[J]. Experimental Brain Research, 1972, 15(4):439-440.

����[72] FREMAUX N, GERSTNER W. Neuromodulated spike-timing-dependent plasticity, and theory of three-factor learning rules[J/OL]. Frontiers in Neural Circuits, 2016, 9[2024-02-21]. https://www.frontiersin.org/articles/10.3389/fncir.2015.00085/full. DOI:10.3389/fncir.2015.00085.

����[73] LELE A S, FANG Y, TING J, et al. An end-to-end spiking neural network platform for edge robotics: From event-cameras to central pattern generation[J]. IEEE Transactions on Cognitive and Developmental Systems, 2021, 14(3):1092-1103.

����[74] AZIMIRAD V, RAMEZANLOU M T, SOTUBADI S V, et al. A consecutive hybrid spiking-convolutional (CHSC) neural controller for sequential decision making in robots[J]. Neurocomputing, 2022, 490:319-336.

����[75] ARENA E, ARENA P, STRAUSS R, et al. Motor-skill learning in an insect inspired neuro-computational control system[J/OL]. Frontiers in Neurorobotics, 2017, 11[2024-03-16]. https://www.frontiersin.org/articles/10.3389/fnbot.2017.00012/full. DOI:10.3389/fnbot.2017.00012.

����[76] RUECKERTE, KAPPEL D, TANNEBERG D, et al. Recurrent spiking networks solve planning tasks[J/OL]. Scientific Reports, 2016, 6(1)[2024-03-22]. https://www.nature.com/articles/srep21142. DOI:10.1038/srep21142.

����[77] MILLER E, COHEN J. An integrative theory of prefrontal cortex function[J]. Annual Review of Neuroscience, 2001, 24(1):167-202.

����[78] BATTAGLIA-MAYER A, CAMINITI R. Corticocortical systems underlying high-order motor control[J]. Journal of Neuroscience, 2019, 39(23):4404-4421.

����[79] DOYA K. Complementary roles of basal ganglia and cerebellum in learning and motor control[J]. Current Opinion in Neurobiology, 2000, 10(6):732-739.

����[80] COTE M, MURRAY L, KNIJOUK M. Spinal control of locomotion: Individual neurons, their circuits and functions[J/OL]. Frontiers in Physiology, 2018, 9[2024-03-01]. https://www.frontiersin.org/journals/physiology/articles/10.3389/fphys.2018.00784/full. DOI:10.3389/fphys.2018.00784.

����[81] SWEET L, GOOD M. Redefinition of the robot motion-control problem[J]. IEEE Control Systems Magazine, 1985, 5(3):18-25.

����[82] SICILIANO B, SCIAVICCO L, VILLANI L, et al. Force control[M]. Berlin, Germany: Springer, 2009:102.

����[83] CH AIMOWICZ L, SUGAR T, KUMAR V, et al. An architecture for tightly coupled multi-robot cooperation[C]//IEEE International Conference on Robotics and Automation. Piscataway, USA: IEEE, 2001:2992-2997.

����[84] ���ǿ, ������, �, ��. ���������˻��ӿڵ��˻�Э���˶����Ʒ���[J]. ��Ϣ�����, 2022, 51(2):237-246.

����[85] CARRILLO R R, ROSE D, BOUCHENY C, et al. A real-time spiking cerebellum model for learning robot control[J]. Biosystems, 2008, 94(1/2):18-27.

����[86] BING Z S, MESCHEDE C, HUANG K, et al. End to end learning of spiking neural network based on R-STDP for a lane keeping vehicle[C]//IEEE International Conference on Robotics and Automation. Piscataway, USA: IEEE, 2018:4725-4732.

����[87] BING Z S, MESCHEDE C, CHENG B, et al. Indirect and direct training of spiking neural networks for end-to-end control of a lane-keeping vehicle[J]. Neural Networks, 2020, 121:21-36.

����[88] LELE A S, FANG Y, ANWAR A, et al. Bio-mimetic high-speed target localization with fused frame and event vision for edge application[J/OL]. Frontiers in Neuroscience, 2022, 16[2024-03-15]. https://www.frontiersin.org/journals/neuroscience/articles/10.3389/fnins.2022.1010302/full. DOI:10.3389/fnins.2022.1010302.

����[89] DEWOLF T, PATEL K, JAWORSKI P, et al. Neuromorphic control of a simulated 7-DOF arm using Loihi[J/OL]. Neuromorphic Computing and Engineering, 2023, 3(1)[2024-02-19]. https://iopscience.iop.org/journal/2634-4386/page/Focus_Issue_on_Machine_Learning_for_Neuromorphic_Engineering.

����[90] HAN B, SRINIVASAN G, ROY K. RMP-SNN: Residual membrane potential neuron for enabling deeper high-accuracy and low-latency spiking neural network[C]//IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway, USA: IEEE, 2020:13558-13567.

����[91] LELE A S, FANG Y, TING J, et al. Learning to walk: Spike based reinforcement learning for hexapod robot central pattern generation[C]//2nd IEEE International Conference on Artificial Intelligence Circuits and Systems. Piscataway, USA: IEEE, 2020:208-212.

����[92] ABADIA I, NAVEROS F, ROSE D, et al. A cerebellar-based solution to the nondeterministic time delay problem in robotic control[J/OL]. Science Robotics, 2021, 6(58)[2024-03-18]. https://www.science.org/doi/10.1126/scirobotics.abf2756.

����[93] OIKONOMOU K M, KANSIZOGLOU I, GASTERATOS A. A hybrid spiking neural network reinforcement learning agent for energy-efficient object manipulation[J/OL]. Machines, 2023, 11(2)[2024-01-19]. https://www.mdpi.com/2075-1702/11/2/162. DOI:10.3390/machines11020162.

����[94] OIKONOMOU K M, KANSIZOGLOU I, GASTERATOS A. A Hybrid reinforcement learning approach with a spiking actor network for efficient robotic arm target reaching[J]. IEEE Robotics and Automation Letters, 2023, 8(5):3007-3014.

����[95] AMAYA C, VON A A. Neurorobotic reinforcement learning for domains with parametrical uncertainty[J/OL]. Frontiers in Neurorobotics, 2023, 17[2024-03-11]. https://www.frontiersin.org/articles/10.3389/fnbot.2023.1239581/full. DOI:10.3389/fnbot.2023.1239581.

����[96] DUPEYROUX J, HAGENAARS J J, PAREDES-VALLES F, et al. Neuromorphic control for optic-flow-based landing of MAVs using the Loihi processor[C]//IEEE International Conference on Robotics and Automation. Piscataway, USA: IEEE, 2021:96-102.

����[97] BATRES-MENDOZA P, GUERRA-HERNANDEZ E I, ESPINAL A, et al. Biologically-inspired legged robot locomotion controlled with a BCI by means of cognitive monitoring[J]. IEEE Access, 2021, 9:35766-35777.

����[98] CHENG X, HAO Y Z, XU J M, et al. LISNN: Improving spiking neural networks with lateral interactions for robust object recognition[C]//29th International Joint on Artificial Intelligence. New York, USA: ACM, 2020:1519-1525.

����[99] ABUBAKER B A, RAZMARA J, KARIMPOUR J. A novel approach for target attraction and obstacle avoidance of a mobile robot in unknown environments using a customized spiking neural network[J/OL]. Applied Sciences, 2023, 13(24)[2024-02-19]. https://www.mdpi.com/2076-3417/13/24/13145. DOI:10.3390/app132413145.

����[100] ZAIDEL Y, SHALUMOVA V, VOLINSKIA, et al. Neuromorphic NEF-based inverse kinematics and PID control[J]. Frontiers in Neurorobotics, 2021, 15[2024-03-24]. https://www.frontiersin.org/articles/10.3389/fnbot.2023.1239581/full. DOI:10.3389/fnbot.2023.1239581.

����[101] LUQUE N R, GARRIDO J A, CARRILLO R R, et al. Adaptive cerebellar spiking model embedded in the control loop: Context switching and robustness against noise[J]. International Journal of Neural Systems, 2011, 21(5):385-401.

����[102] HOGAN N. Impedance control: An approach to manipulation[C]//American Control Conference. Piscataway, USA: IEEE, 1984:304-313.

����[103] CALANCA A, MURADORE R, FIORINI P. A review of algorithms for compliant control of stiff and fixed-compliance robots[J]. IEEE/ASME Transactions on Mechatronics, 2015, 21(2):613-624.

����[104] DIAMOND A, KNIGHT R, DEVEREUX D, et al. Anthropomimetic robots: Concept, construction and modelling[J/OL]. International Journal of Advanced Robotic Systems, 2012, 9(5)[2024-01-27]. https://journals.sagepub.com/doi/10.5772/52421. DOI:10.5772/52421.

����[105]RUSD��TOLLEYM T.Design��fabricationandcontrolofsoftrobots[J].Nature��2015��521(7553)��467-475.

����[106]ZHANGHB��LIYS��GUOYP��etal.ControlofpneumaticartificialmuscleswithSNN��basedcerebellar likemodel[C]//InternationalConferenceonSocialRobotics.Berlin��Germany��Springer��2021��824-828.

����[107]CHENXY��ZHUW X��LIANGW Y��etal.ControlofantagonisticMcKibbenmusclesviaabio��inspiredapproach[J].JournalofBionicEngineering��2022��19(6)��1771-1789.

����[108]XINGDP��LIJL��ZHANGTL��etal.Abrain��inspiredapproachforcollision��freemovementplanninginthesmalloperational space[J].IEEETransactionsonNeuralNetworksandLearningSystems��2022��33(5)��2094-2105.

����[109]LIQK��PANGYB��WANGYS��etal.CBMC��Abiomimeticapproachforcontrolofa7��degreeoffreedomroboticarm[J/OL].Biomimetics��2023��8(5)[2024-02-18].https��//www.mdpi.com/2313-7673/8/5/389.DOI��10.3390/biomimetics8050389.

����[110]SUOMALAINENM��KARAYIANNIDISY��KYRKIV.Asurveyofrobotmanipulationincontact[J].RoboticsandAutonomousSystems��2022��156[2024-03-18].https��//linkinghub.elsevier.com/retrieve/pii/S0921889022001312.DOI��10.1016/j.robot.2022.104224.

����[111]BUTTERFASSJ��HIRZINGERG��KNOCHS��etal.DLR′smultisensoryarticulatedhand.I.Hard��andsoftwarearchitecture[C]//IEEEInternationalConferenceonRoboticsandAutomation.Piscataway��USA��IEEE��1998��2081-2086.

����[112]ANDRYCHOWICZOAIM��BAKERB��CHOCIEJM��etal.Learningdexterousin��handmanipulation[J].TheInternationalJournalofRoboticsResearch��2020��39(1)��3-20.

����[113]STARKEJ��EICHMANNC��OTTENHAUSS��etal.Human��inspiredrepresentationofobject��specificgraspsforanthropomorphichands[J/OL].InternationalJournalofHumanoidRobotics��2020��17(2)[2024-03-11].https��//www.worldscientific.com/doi/abs/10.1142/S0219843620500085.DOI��10.1142/S0219843620500085.

����[114]ZHOUT��WACHSJP.Spikingneuralnetworksforearlypredictioninhuman��robotcollaboration[J].TheInternationalJournal of RoboticsResearch��2019��38(14)��1619-1643.

����[115]ZHANGR��LIJ��ZHENGP��etal.Afusion��basedspikingneuralnetworkapproachforpredictingcollaborationrequestinhuman robotcollaboration[J/OL].RoboticsandComputer��IntegratedManufacturing��2022��78[2024-02-14].https��//linkinghub.elsevier.com/retrieve/pii/S0736584522000709.DOI��10.1016/j.rcim.2022.102383.

����[116]PAUGAM��MOISYH��BOHTESM.Computingwithspikingneuronnetworks[M]//HandbookofNaturalComputing.Berlin��Germany��Springer��2012��1��335-376.

����[117]MEHONICA��SEBASTIANA��RAJENDRANB��etal.Memristors��from in��memorycomputing��deeplearningacceleration��andspikingneuralnetworkstothefutureofneuromorphicandbio��inspiredcomputing[J/OL].AdvancedIntelligentSystems��2020��2(11)[2023-03-16].https��//onlinelibrary.wiley.com/doi/10.1002/aisy.202000085.DOI��10.1002/aisy.202000085.

����[118]JAVDANIS��ADMONIH��PELLEGRINELLIS��etal.Sharedautonomyviahindsightoptimizationforteleoperationandteaming[J].TheInternationalJournalofRoboticsResearch��2018��37(7)��717-742.

����[119]LIUHY��WANGLH.Humanmotionpredictionforhuman��robotcollaboration[J].JournalofManufacturingSystems��2017��44��287-294.

����[120]ZHOUT��WACHSJP.Earlyturn��takingpredictionwithspikingneuralnetworksforhumanrobotcollaboration[C]//IEEE InternationalConferenceonRoboticsandAutomation.Piscataway��USA��IEEE��2018��3250-3256.

����[121]FENGSQ��XUW J��YAOBT��etal.Earlypredictionofturn��takingbasedonspikingneuronnetworktofacilitatehuman robot collaborativeassembly[C]//18thInternationalConferenceonAutomationScienceandEngineering.Piscataway��USA��IEEE��2022��123-129.

����[122]YUQ��YAOY��WANGL��etal.Robustenvironmentalsoundrecognitionwithsparsekey��pointencodingandefficientmultispikelearning[J].IEEETransactionsonNeuralNetworksandLearningSystems��2020��32(2)��625-638.

����[123]WUJB��LIUQ��ZHANGM L��etal.HuRAI��Abrain��inspiredcomputationalmodelforhuman��robotauditoryinterface[J].Neurocomputing��2021��465��103-113.

ת����ע�����ԣ�http://www.lunwencheng.com/lunwen/dzi/22694.html